Siapa yang paling tahu tentang diri kita? Mungkin bukan kita sendiri, melainkan platform-platform digital yang setiap detik mengoleksi miliaran titik data dari setiap klik, jeda, dan jejak-jejak digital kita. Bahkan sebelum kita menyadarinya, platform2 digital bisa memprediksi keputusan kita berikutnya. Siklus digital ini, bukan sekadar efisiensi teknologi, tapi pergeseran kuasa pengetahuan yang sangat besar.

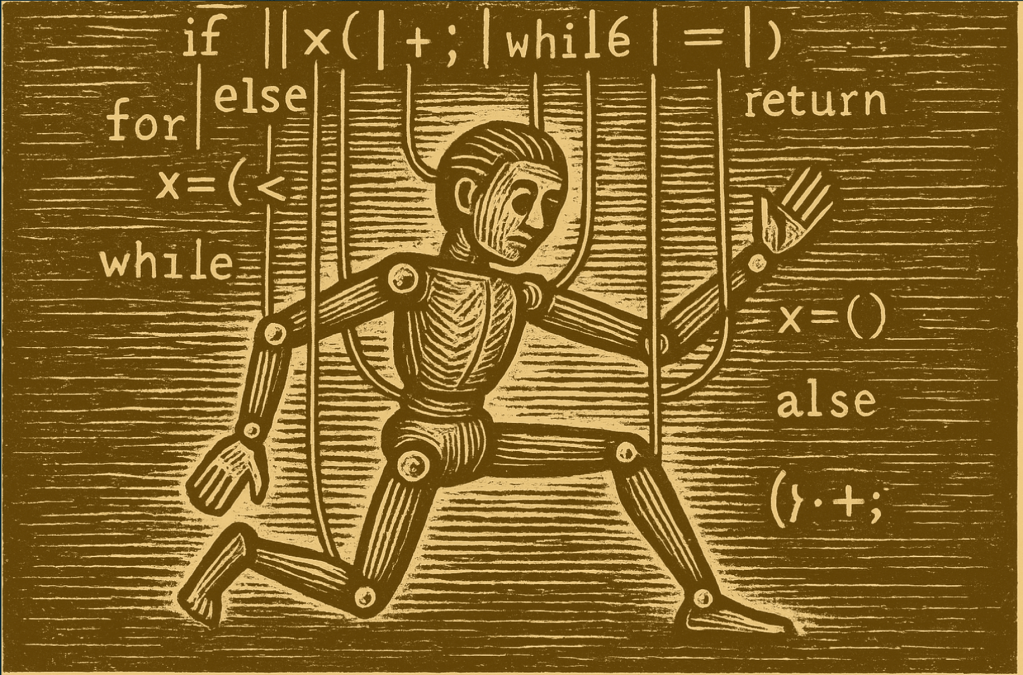

Kita hidup di bawah bayang-bayang ketimpangan epistemik, sebuah kondisi ketika akses terhadap informasi tidak hanya tidak merata, tetapi juga secara sistemik dimanipulasi. Shoshana Zuboff menyebut kondisi ini sebagai hasil dari surveillance capitalism, situasi ketika pengalaman manusia dikumpulkan secara diam-diam sebagai “behavioral surplus” untuk dikomodifikasi, diprediksi, dan dijual. Melalui konsep instrumentarian power, Zuboff membuka tabir tentang bentuk kekuasaan baru yang tidak bersandar pada kekerasan fisik, melainkan pada kendali algoritmik yang membentuk perilaku tanpa persetujuan sadar dari individu.

Ketimpangan epistemik ini menciptakan situasi di mana realitas digital disusun berdasarkan nilai ekonomi dari perhatian dan pola interaksi virtual kita, bukan berdasarkan kepentingan publik atau sosial. Ketika kita menganggap informasi sebagai komoditas yang dikurasi oleh platform, kita kehilangan hak untuk menyusun narasi bersama sebagai masyarakat. Inilah yang disebut Zuboff sebagai bentuk pengambilalihan domain pengalaman manusia oleh kekuatan komputasional.

Dalam perluasan makna ini, Luciano Floridi, seorang filsuf informasi, memperkenalkan istilah infopower, bahwa kontrol atas informasi menghasilkan kekuasaan epistemik, etis, dan politik. Dalam konteks digital, infopower adalah bagian dari dominasi infrastruktur teknologi terhadap hak kita untuk mengetahui, memilih, dan menentukan makna atas pengalaman kita. Floridi menyerukan pentingnya informational self-determination, yaitu kebebasan individu untuk mengatur bagaimana data dan identitas digitalnya digunakan dan diinterpretasikan.

Namun, kuasa atas informasi tidak hanya tentang akses dan kendali atas data, melainkan juga tentang siapa yang berhak menafsirkan dunia. Ketika arsitektur algoritmik merancang lintasan informasi yang kita lihat, ia juga secara diam-diam mengarahkan perspektif, membentuk apa yang kita anggap benar, relevan, dan penting. Dalam konteks inilah, ketimpangan epistemik menjelma menjadi kolonialisasi kognitif: pengambilalihan pola pikir dan horizon interpretasi manusia oleh logika teknokapitalisme. Kita tidak hanya kehilangan kendali atas data, tapi juga atas penafsiran struktur makna yang mengelilingi kehidupan kita sehari-hari.

Sebagai contoh, sistem rekomendasi tidak hanya memilihkan konten yang ‘sesuai’, tapi juga mempersempit kemungkinan eksplorasi dan memperkuat bias yang sudah ada. Kita tidak lagi menemukan dunia secara otonom, tetapi diarahkan untuk melihat versi dunia yang paling menguntungkan platform. Dalam kondisi ini, relasi antara manusia dan teknologi tidak lagi bersifat simbiotik, tetapi hegemonik—satu pihak mengatur, pihak lain mengikuti.

Zeynep Tufekci, seorang teknososialis, memperkuat argumen ini dengan menunjukkan bahwa algoritma tak hanya berperan dalam distribusi konten, tapi juga dalam rekayasa perilaku. Melalui studi tentang algoritma YouTube, Tufekci menunjukkan bagaimana sistem menyarankan konten yang semakin ekstrem demi meningkatkan retention rate pengguna. Proses ini bukan sekedar soal apa yang kita tonton, tapi bagaimana cara berpikir kita diarahkan, tanpa sadar.

Bahaya sebenarnya dari model ini bukan hanya terletak pada penyebaran informasi yang keliru atau menyesatkan, tetapi pada pelapisan bertahap terhadap proses berpikir kritis masyarakat. Ketika algoritma mengejar engagement semata, maka konten yang paling sensasional, menyenangkan, mengganggu, marah, atau menegangkan akan mendapatkan tempat paling tinggi. Kita akhirnya hidup dalam ekosistem informasi yang mendorong reaksi, bukan reflektif — dan dalam jangka panjang, melemahkan kapasitas kolektif untuk membentuk opini rasional dan demokratis.

Masih dalam konteks yang sama, Evgeny Morozov dalam The Net Delusion memperingatkan bahwa meski teknologi terlihat memberdayakan, teknologi juga menciptakan ilusi kebebasan. Sistem yang tampak transparan sering kali menyembunyikan pengawasan dan kontrol terselubung, menjauhkan kita dari keputusan yang sungguh-sungguh demokratis.

Morozov menggambarkan lanskap digital sebagai ruang yang penuh jebakan optimisme palsu. Kita diberi akses, tapi tidak diberi kuasa. Kita diberi suara, tetapi tidak diberi pengaruh nyata. Ilusi partisipasi ini memperkuat status quo kekuasaan digital, dan dalam diam, menghapus peluang munculnya gerakan perubahan yang lebih organik dan otentik.

Konsekuensi Sosial dari Asimetri Epistemik

Epistemic asymmetry tidak sekadar menghasilkan ketimpangan akses terhadap informasi, tetapi juga menggeser posisi publik dari subjek yang otonom menjadi objek data. Ketika pengguna digital menjadi ladang data yang ditambang secara terus-menerus, muncul efek domino yang mengancam fondasi masyarakat demokratis.

Salah satu dampak yang paling terasa adalah erosi terhadap agenda setting oleh media. Di masa lalu, media massa memegang peran penting dalam menentukan apa yang menjadi perhatian publik. Kini, peran tersebut perlahan digeser oleh algoritma distribusi yang mendahulukan konten berdasarkan performa engagement, bukan kepentingan publik. Hasilnya adalah disorientasi kolektif: kesadaran publik dibentuk oleh klik dan algoritma, bukan oleh kebutuhan sosial.

Dalam konteks ini, Evgeny Morozov dalam The Net Delusion memperingatkan bahwa meski teknologi terlihat memberdayakan, ia juga menciptakan ilusi kebebasan. Sistem yang tampak transparan sering kali menyembunyikan pengawasan dan kontrol terselubung, menjauhkan kita dari keputusan yang sungguh-sungguh demokratis.

Morozov menggambarkan lanskap digital sebagai ruang yang penuh jebakan optimisme palsu. Kita diberi akses, tapi tidak diberi kuasa. Kita diberi suara, tetapi tidak diberi pengaruh nyata. Ilusi partisipasi ini memperkuat status quo kekuasaan digital, dan dalam diam, menghapus peluang munculnya gerakan perubahan yang autentik dan terinformasi.

Cathy O’Neil, melalui Weapons of Math Destruction, membongkar sisi gelap sistem algoritmik yang tampak objektif namun sesungguhnya berbahaya. Ia mengungkap bagaimana model prediktif digunakan untuk menilai risiko individu berdasarkan data historis yang bias, tanpa ada proses koreksi atau pengawasan. Ini terjadi di sektor pendidikan, perbankan, asuransi, dan hukum, di mana sistem keputusan otomatis bisa menghukum individu berdasarkan statistik semata. Ketika kesalahan algoritmik tak bisa ditelusuri, ketidakadilan menjadi struktur, bukan pengecualian.

Lebih jauh lagi, dominasi Superapp — aplikasi multifungsi yang banyak digunakan — memperlihatkan bagaimana akumulasi data dalam satu ekosistem menciptakan kekuatan prediksi dan kontrol yang luar biasa. Dari lokasi, transaksi keuangan, hingga kebiasaan konsumsi, semuanya dikumpulkan dan dimodelkan untuk menciptakan profil pengguna yang semakin presisi. Ini memperluas dimensi asimetri epistemik ke dalam ruang-ruang hidup sehari-hari yang paling privat.

Frank Pasquale, melalui The Black Box Society, mengilustrasikan bagaimana sistem algoritmik yang tertutup memperburuk situasi ini. Ketika keputusan-keputusan penting diambil oleh sistem yang tidak bisa diakses publik, maka prinsip transparansi dan akuntabilitas publik runtuh. Dalam dunia yang dikendalikan oleh algoritma tersembunyi, masyarakat kehilangan kemampuan untuk memahami mengapa suatu keputusan diambil, oleh siapa, dan berdasarkan logika apa. Akibatnya, kepercayaan publik terhadap institusi sosial dan politik bisa runtuh, karena ketidakpastian dan ketertutupan melahirkan rasa alienasi yang dalam.

Menuju Regulasi dan Kesadaran Kultural

Menjawab tantangan ini tidak cukup dengan solusi teknis. Kita perlu merumuskan ulang kerangka etika dan politik informasi di lanskap digital. Shoshana Zuboff menyerukan reformasi sistemik berupa larangan pengumpulan data perilaku tanpa persetujuan sadar, serta penerapan prinsip data minimalism yang menempatkan kendali di tangan pengguna.

Namun solusi hukum harus dilengkapi dengan kesadaran kultural. Kita perlu membangun literasi digital yang tidak hanya fokus pada penggunaan teknologi, tetapi pada pemahaman struktur kuasa dan logika ekonomi di balik desainnya. Literasi seperti ini mencakup pertanyaan: siapa yang diuntungkan, siapa yang dirugikan, dan bagaimana kita bisa membangun sistem yang lebih adil.

Floridi, Tufekci, Morozov, O’Neil, dan Pasquale semuanya menyumbang pada pembentukan narasi ini. Dari filosofi informasi hingga kritik algoritmik, para ilmuwan aktivis membuka mata kita pada lanskap kuasa yang tersembunyi di balik user interface yang ramah. Jika kita ingin mempertahankan kebebasan berpikir, berekspresi, dan hidup sebagai manusia utuh di era digital, maka epistemic self-defense menjadi agenda mendesak. Ini bukan sekadar soal perlindungan data, tapi soal mempertahankan martabat manusia dari reduksi algoritmik. Sebagaimana Zuboff mengingatkan: “If we do not assert our right to a future tense, someone else will make the future for us and sell it back to us at a profit.”

Leave a comment